Desde el año pasado vengo diciendo algo que a muchos les suena extremo: a partir de 2026, yo ya no me quiero atender con ningún médico que no use inteligencia artificial como apoyo. No porque desconfíe de la medicina, sino porque confío demasiado en los datos como para ignorarlos.

El punto de partida: los humanos nos equivocamos más de lo que creemos

Cuando digo que no me quiero atender con médicos sin IA, no es un slogan marketinero: es una conclusión incómoda después de mirar años de evidencia sobre errores diagnósticos y sobre lo que están logrando los modelos de IA médica.

En hospitales de EE. UU., un estudio sobre más de 2.400 pacientes que terminaron en terapia intensiva o fallecieron encontró que el 23% tuvo al menos un error diagnóstico, y que el 17% sufrió daño por ese error; en el 6,6% de las muertes, el error diagnóstico fue un factor contribuyente. Otro análisis de Johns Hopkins estima que unas 795.000 personas por año en EE. UU. mueren o quedan con discapacidad permanente por errores de diagnóstico. En atención primaria, pediatría y guardias, hay trabajos que hablan de tasas de error del orden del 10%, y en radiología y patología, incluso en práctica real, se ve un 2–4% de errores.[1][2][3][4]

¿Te imaginás cualquier otra industria tolerando este nivel de error sin apoyarse en sistemas automáticos? No dejaríamos volar un avión con un piloto sin instrumentos; sin embargo, todavía aceptamos que un médico diagnostique solo con su memoria, su formación y lo que puede leer al vuelo en una guardia saturada.

El contexto global: no alcanzan los médicos

A eso sumale un problema estructural: no es que sobren médicos, es que faltan. La OMS proyecta un déficit de alrededor de 11 millones de trabajadores de la salud para 2030, especialmente en países de ingresos bajos y medios. Estimaciones más detalladas hablan de una demanda global de 80 millones de trabajadores de salud para 2030, con una oferta proyectada de 65 millones, o sea una brecha de unos 15 millones de personas.[5][6][7][8]

Traducido: incluso si todos los médicos fueran perfectos, no llegamos. La IA acá no es un capricho futurista: es la única manera realista de ampliar capacidad diagnóstica sin esperar décadas a formar más especialistas.

Google: de aprobar exámenes médicos a ganarle a los clínicos

Primero, miremos qué está haciendo Google. Durante años venían publicando modelos como Med-PaLM, entrenados específicamente para preguntas médicas estilo examen de residencia. La segunda versión, Med-PaLM 2, llegó a un 86,5% de acierto en el benchmark MedQA, que usa preguntas tipo USMLE (el examen de licencia médica de EE. UU.). En estudios internos, las respuestas largas de Med-PaLM 2 fueron preferidas sobre las de médicos en 8 de 9 criterios (factualidad, razonamiento, alineación con guías, etc.).[9][10][11]

Eso ya era fuerte, pero no era todavía “consultorio real”; eran exámenes. El salto llega con AMIE (Articulate Medical Intelligence Explorer), un modelo conversacional diseñado específicamente para consulta clínica. En un estudio publicado en Nature, compararon AMIE con 20 médicos clínicos en 159 casos simulados con “pacientes estandarizados” en India, Canadá y el Reino Unido, en un diseño randomizado doble ciego. Resultado: AMIE tuvo significativamente mejor precisión diagnóstica top‑1 y top‑3 que los médicos, y además fue evaluada como más empática y mejor comunicadora por especialistas y por los propios “pacientes”.[12][13]

Dicho en criollo: un modelo de lenguaje, bien entrenado para medicina, en un entorno controlado, no solo diagnostica mejor, sino que muchos pacientes lo perciben como más claro y empático. ¿No es un dato incómodo para todos los que dicen “la IA nunca va a reemplazar el trato humano”?

Microsoft: un “equipo virtual” que diagnostica cuatro veces mejor

Del lado de Microsoft, la línea de trabajo fuerte es el MAI Diagnostic Orchestrator (MAI‑DxO), que no es un solo modelo sino un “director de orquesta” de varios modelos grandes, incluyendo GPT‑4o y otros. Lo probaron en 304 casos reales publicados en el New England Journal of Medicine, simulando el proceso diagnóstico paso a paso: arrancar con pocos datos, decidir qué preguntar o qué estudio pedir, interpretar resultados y llegar a un diagnóstico final.[14][15][16]

En esos tests, MAI‑DxO logró alrededor de 80–85,5% de diagnósticos correctos, mientras que un grupo de médicos expertos rondó el 20% en los mismos casos, es decir, la IA fue unas cuatro veces más precisa. Encima, el sistema logró esa precisión ordenando estudios un 20% más baratos en promedio, optimizando qué pedir en cada paso.[17][15][18][16][14]

Acá la analogía es muy clara: es como ponerle al médico un equipo de súper especialistas discutiendo el caso en tiempo real, 24/7, sin cansarse, sin sesgos de “ya vi tres neumonías hoy, seguro esta también lo es”. MAI‑DxO es, básicamente, una junta médica virtual automatizada.

IA abierta de Google: MedGemma y fundaciones médicas

Ahora, vos me podés decir: “Todo bien, pero eso es cloud privado de big tech, ¿qué hay de modelos abiertos que podamos usar en Argentina, on‑premise, sin mandar datos a otro país?”.

Google, en paralelo a sus modelos cerrados, lanzó MedGemma, una colección de modelos abiertos especializados en texto e imagen médica, construidos sobre la arquitectura Gemma 3. Hay versiones de 4B parámetros multimodal (texto + imágenes) y de 27B, algunas orientadas a texto, otras multimodales, pensadas para tareas como interpretación de imágenes médicas, comprensión de texto clínico y razonamiento clínico. Los modelos están disponibles bajo licencias abiertas para investigación y desarrollo, con la propia documentación remarcando que no son, por sí solos, productos diagnósticos listos para uso clínico: requieren validación y adaptación local.[19][20][21]

Además, Google liberó el repositorio Medical AI Research Foundations, donde abre código y modelos de base como REMEDIS, entrenados sobre datos públicos de radiografías de tórax y patología, para que investigadores puedan usarlos como punto de partida para modelos diagnósticos. La idea es explícita: democratizar modelos de fundación médica y facilitar que hospitales y universidades construyan sus propias soluciones regulables arriba de esos bloques.[22]

No es menor este detalle: por primera vez tenemos bloques abiertos, de nivel “fundación”, específicamente médicos, que podemos auditar, adaptar y correr cerca del dato, sin depender 100% de una API cerrada.

Microsoft: InnerEye y modelos de salud en Azure

Del lado de Microsoft, la estrategia “abierta” pasa más por herramientas y modelos de imagen que por un único modelo grande para diagnóstico general. Project InnerEye ofrece toolkits open source (MIT) para entrenar modelos de deep learning en imágenes médicas, pensados para flujos como planificación de radioterapia en base a tomografías. Son herramientas PyTorch para que hospitales e investigadores armen y desplieguen sus propios modelos de segmentación y análisis de imágenes, escalando en Azure pero con código y pipelines abiertos.[23]

Por otro lado, Microsoft mantiene un catálogo de “healthcare AI foundation models” en su plataforma Azure, que incluye modelos como MedImageInsight (embeddings de imágenes médicas), MedImageParse (segmentación), CXRReportGen (informes de rayos X) y otros para imágenes, genómica y datos clínicos. Estos modelos no son open weights en todos los casos, pero sí son bloques reutilizables, documentados, con ejemplos y código abierto para desplegarlos y ajustarlos a escenarios reales, siempre bajo la aclaración de que no están diseñados como productos médicos finales sino como base para soluciones reguladas.[24][25][26][27]

La foto general es clara: tanto Google como Microsoft están construyendo un “stack” de IA médica, desde modelos cerrados de altísima performance hasta modelos y toolkits abiertos para que el ecosistema (hospitales, startups, universidades) construya encima.

Estudios donde la IA compite contra médicos (y les gana)

Más allá de AMIE y MAI‑DxO, hay una línea de evidencia cada vez más consistente: en condiciones controladas, los LLMs médicos están igualando o superando a médicos en diagnóstico.

En un ensayo clínico randomizado publicado en JAMA Network Open, se comparó el razonamiento diagnóstico de médicos con y sin acceso a un LLM, usando viñetas clínicas. Resultado curioso: el LLM, solo, tuvo una precisión alrededor de un 16% mayor que el grupo control de médicos usando recursos convencionales, pero cuando los médicos usaban el LLM como ayuda no mejoraron significativamente respecto al grupo sin IA.[28][29][30][31]

Es decir: la “máquina” sola diagnostica mejor que el humano promedio en ese contexto, pero la combinación humano+LLM no mejora automáticamente si el flujo de trabajo está mal diseñado o los médicos no están entrenados para usar la herramienta. Esto refuerza un punto clave: no alcanza con tirar un chatbot en la pantalla del médico y decir “usalo si querés”. Hace falta rediseñar procesos y formar a los equipos.

En oftalmología, distintos trabajos comparan LLMs y modelos de visión como Gemini con oftalmólogos en diagnósticos de retina y nervio óptico, encontrando precisiones comparables o superiores según el caso. Y los sistemas de deep learning para retinopatía diabética de proyectos como Verily han mostrado que pueden leer fondos de ojo más rápido y, en muchos escenarios, más precisamente que oftalmólogos, permitiendo priorizar a pacientes en riesgo en poblaciones donde hay millones de personas con diabetes y falta de especialistas.[32][33][34]

Las limitaciones humanas: cansancio, sesgos y memoria finita

¿Por qué los algoritmos empiezan a ganar en diagnóstico? No porque sean “más inteligentes” en el sentido humano, sino porque están diseñados justo donde más flojeamos nosotros.

Los médicos trabajan muchas veces con guardias interminables, alta presión, ruido constante, pacientes que no cuentan bien la historia clínica y sistemas informáticos que más que ayudar, molestan. No hay memoria humana capaz de retener cientos de guías clínicas actualizadas, miles de efectos adversos de fármacos y patrones sutiles de presentación de enfermedades raras. Estudios muestran que al menos un 5% de los adultos en ámbito ambulatorio experimentará un error diagnóstico a lo largo de su vida, y que la mayoría de las personas tendrá al menos un error diagnóstico alguna vez.[4]

Además, hay sesgos cognitivos: anclaje (“me quedo con la primera hipótesis”), disponibilidad (“me acuerdo de este caso raro que vi y lo sobreestimo”), exceso de confianza, entre otros, que se repiten una y otra vez en los análisis de errores. Una revisión en hospitales mostró que una parte importante de los fallos se daba en la fase de evaluación clínica y otra en la de pedir e interpretar estudios, no por falta de buena voluntad, sino por límites humanos de atención y procesamiento.[3][35][1]

La IA no se cansa, no “pierde la paciencia” en la historia clínica número 40 del día y puede comparar el caso actual con patrones aprendidos de cientos de miles de pacientes. Esa asimetría, bien usada, es un potenciador brutal del médico, no un reemplazo.

Fortalezas algorítmicas: qué hace mejor un modelo que un humano

En diagnóstico médico, los modelos tienen varias ventajas estructurales:

- Pueden integrar múltiples señales: síntomas, antecedentes, laboratorios, imágenes y texto libre, en un espacio vectorial donde comparan con millones de ejemplos previos.[21][19][24]

- Pueden ser calibrados para priorizar seguridad: por ejemplo, maximizando sensibilidad en enfermedades graves aunque implique más falsos positivos, algo que después el médico puede refinar.[19][22]

- Pueden simular “ramas” diagnósticas en paralelo: el enfoque secuencial de MAI‑DxO es básicamente ejecutar mentalmente muchas estrategias diagnósticas y elegir la que mejor balancea precisión y costo.[16][17]

Además, en modelos como MedGemma, la especialización sobre imágenes médicas (rayos, dermatología, histopatología, oftalmología) permite detectar patrones visuales que incluso radiólogos muy entrenados pueden pasar por alto, especialmente en contextos de alta carga de trabajo.[36][19]

Entonces, ¿son infalibles? No. ¿Son, en promedio y bien entrenados, mejores que un humano solo en muchas tareas diagnósticas acotadas? Los datos apuntan cada vez más a que sí. La pregunta no es “si” van a superar en precisión al médico promedio, sino “en qué condiciones y con qué nivel de supervisión”.

Lo que ya funciona en el mundo real

No estamos hablando de ciencia ficción. Los modelos de retinopatía diabética estilo Verily ya se probaron en programas de screening para priorizar pacientes según gravedad en contextos donde hay más de 400 millones de personas con riesgo de ceguera por diabetes y una gran proporción que no llega a ver un oftalmólogo hasta que ya perdió visión.[33][34]

Modelos tipo Med-PaLM 2 se están probando en sistemas de salud de distintos países para ayudar en la documentación clínica, responder preguntas de médicos y hacer chequeos de interacciones medicamentosas, con resultados preliminares que muestran menor carga de documentación y menor “carga cognitiva” percibida por los clínicos. Microsoft, con sus modelos de imagen y orquestadores tipo MAI‑DxO, ya está discutiendo con hospitales piloto cómo integrar ese “equipo virtual de especialistas” en flujos reales.[27][9][16]

La adopción masiva todavía no está, pero el tren ya salió de la estación. La cuestión para países como Argentina es si vamos a subirnos a tiempo o vamos a seguir pidiendo turno por teléfono y diagnosticando a pulmón mientras el resto del mundo arma copilotos clínicos serios.

El modelo que propongo: médico + IA, siempre con decisión final humana

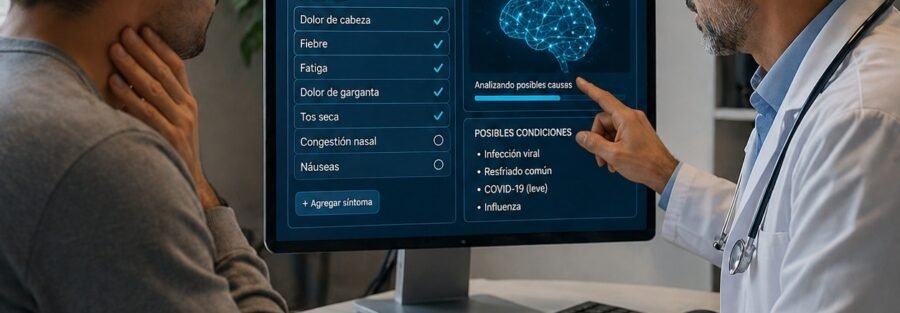

Acá viene mi postura, que repito cada vez que tengo un micrófono enfrente: el médico no tiene que desaparecer, pero tampoco tiene sentido que diagnostique solo. El setup que yo quiero como paciente es muy simple:

- El paciente cuenta sus síntomas y antecedentes al médico, como siempre.

- El médico ingresa esos datos estructurados en un sistema de IA clínica (basado en modelos tipo MedGemma, Med-PaLM, MAI‑DxO o modelos locales entrenados con datos argentinos).[26][22][24][19]

- El sistema devuelve un ranking de diagnósticos probables, banderas rojas, sugerencias de estudios y posibles interacciones de medicación, con un razonamiento explicable.

- El médico, con su criterio, experiencia y conocimiento del contexto del paciente, decide: puede seguir la recomendación, descartarla o combinarla con hipótesis propias.

La última palabra la tiene siempre el médico, pero nunca más debería tomarla sin esa “segunda opinión” algorítmica. Es como un piloto que sigue siendo quien decide, pero con un cockpit lleno de instrumentos, checklist y sistemas de alerta temprana. Nadie serio quiere un avión “sólo IA”, pero tampoco queremos uno sin instrumentos.

Por qué digo que ya no quiero médicos sin IA

Con todo lo anterior, cuando digo “no me quiero atender con un médico que no use IA”, lo que realmente estoy diciendo es: si sé que hay herramientas que, en estudios controlados, diagnostican cuatro veces mejor que médicos expertos en casos complejos, que modelos como AMIE superan a clínicos en precisión y hasta en empatía en consultas simuladas, y que tenemos modelos abiertos como MedGemma para construir soluciones locales, me resulta éticamente difícil justificar que no se usen.[13][15][18][20][12][14][16][21][19]

¿Vamos a seguir aceptando que un 10% de diagnósticos en ciertos ámbitos se equivoquen, que casi 800.000 personas por año en un solo país sufran daño grave por errores diagnósticos, mientras tenemos modelos que podrían haber evitado una proporción significativa de esos casos, solo porque “da miedo” cambiar el flujo de trabajo? Esa es la conversación incómoda que prefiero tener ahora y no dentro de diez años.[2][3]

Un proyecto de ley para Argentina: diagnóstico asistido por IA

En este contexto, no alcanza con que algunos médicos “a título personal” usen IA. Por eso estoy trabajando en un proyecto de ley para presentar vía diputados en Argentina, con un objetivo concreto: habilitar explícitamente y promover el uso de sistemas de IA en el proceso diagnóstico, bajo reglas claras.

¿Qué imagino como mínimos de esa ley?

- Que los médicos puedan usar sistemas de IA médicos validados, dejando registro en la historia clínica de las recomendaciones de la IA y de la decisión final.

- Que los modelos usados (sean cerrados o basados en open source tipo MedGemma, REMEDIS o herramientas como InnerEye) cumplan con criterios de desempeño mínimo frente a benchmarks clínicos y validación local.[23][22][19]

- Que se protejan los datos de los pacientes, privilegiando despliegues on‑premise o en nubes que cumplan estándares claros, aprovechando justamente que hoy existen modelos médicos abiertos que se pueden correr sin mandar los datos crudos fuera del país.[25][36][19]

- Que haya auditorías periódicas de sesgos (por ejemplo, desempeño en distintas regiones, géneros, grupos etarios), porque un modelo entrenado solo con datos de otro país puede fallar más en nuestra población si no se adapta.[22][26]

¿Es fácil? No. ¿Es más difícil que seguir tolerando un nivel de error diagnóstico que, si lo viéramos en aviación o en la industria nuclear, sería un escándalo mundial? Tampoco.

Objeciones típicas y cómo las encaro

Hay tres miedos que aparecen siempre:

- “La IA al final se va a equivocar y nadie va a ser responsable.”

Ya hoy, si un médico se equivoca, hay un responsable y un sistema legal detrás. La IA no borra la responsabilidad profesional: la desplaza hacia un modelo médico+IA donde se documenta qué recomendó la herramienta y qué decidió el médico. De hecho, un buen sistema deja más trazabilidad que el “lo vi rápido en la guardia y me pareció tal cosa”. - “La IA es una caja negra, no se puede confiar.”

Mucho de lo que hace el cerebro humano también es una caja negra. La diferencia es que podemos medir y versionar modelos, someterlos a benchmarks públicos (MedQA, SDBench, etc.) y exigir performance mínima, cosa que con el humano individual no podemos hacer de forma tan sistemática. Eso no quita que haya que trabajar en interpretabilidad, pero el estándar de evidencia puede ser incluso más alto que el que hoy pedimos a un médico individual.[11][17][16] - “La IA va a reemplazar médicos.”

Si hay una cosa que muestran los estudios de JAMA es que tirar un LLM crudo en manos de médicos sin entrenamiento no mejora mágicamente los resultados. Lo que sí mejora es diseñar sistemas donde la IA hace lo que mejor hace (explorar el espacio de diagnósticos y sugerir caminos) y el médico hace lo que mejor hace (integrar contexto humano, valores del paciente, trade‑offs, comunicación). El modelo que yo defiendo es explícitamente de acople, no de reemplazo.[29][30][31]

Disparadores para los próximos años

Te dejo algunas preguntas que me hago todo el tiempo, y que, creo, nos tenemos que hacer como sistema de salud:

- ¿Debería ser considerado mala praxis, en unos años, no usar IA cuando está disponible y validada para un tipo de diagnóstico concreto?

- ¿Cómo nos aseguramos de que los hospitales públicos accedan a estos modelos abiertos (MedGemma, REMEDIS, InnerEye, etc.) y no quede solo como lujo de algunas clínicas privadas?[19][23][22]

- ¿Qué pasaría si, en Argentina, enfocáramos IA médica primero donde más duele: atención primaria, guardias y diagnósticos de alto impacto (ACV, infarto, cáncer), justamente donde los errores hoy son más frecuentes y más costosos en vidas?[2][3][4]

Yo, por mi parte, voy a seguir sosteniendo lo mismo: quiero médicos que trabajen con IA, no contra ella. Quiero que la última palabra sea del médico, pero quiero que esa palabra esté informada por el mejor copiloto algorítmico posible. Y quiero que en Argentina eso no quede solo en manos de la buena voluntad individual, sino que se convierta en política pública, con leyes, estándares y sistemas que realmente salven vidas.

⁂

- https://news.harvard.edu/gazette/story/2024/01/research-assesses-rates-causes-of-diagnostic-errors/

- https://www.hopkinsmedicine.org/news/newsroom/news-releases/2023/07/report-highlights-public-health-impact-of-serious-harms-from-diagnostic-error-in-us

- https://www.improve-dx.org/sites/default/files/2025-06/Diagnostic Error – An Overview.pdf

- https://www.ncbi.nlm.nih.gov/books/NBK555525/

- https://pmc.ncbi.nlm.nih.gov/articles/PMC9237893/

- https://openknowledge.worldbank.org/entities/publication/2391d874-01f0-5331-8801-9c9d07f42ec1

- https://www.oucru.org/world-health-worker-week-2025/

- https://www.who.int/health-topics/health-workforce

- https://www.linkedin.com/posts/pallavindev_aiinhealthcare-medicalai-healthtech-activity-7402308148742774784-j6pH

- https://dr7.ai/blog/model/top-5-medical-ai-models-compared-medgemma-gpt-4-med-palm-2-more/

- http://sites.research.google/gr/med-palm/

- https://www.youtube.com/watch?v=aaSJ18KIdl4

- https://towardsdatascience.com/googles-new-ai-system-outperforms-physicians-in-complex-diagnoses/

- https://time.com/7299314/microsoft-ai-better-than-doctors-diagnosis/

- https://qz.com/microsoft-says-its-new-ai-is-way-better-than-doctors-at-diagnosing-patients

- https://www.wired.com/story/microsoft-medical-superintelligence-diagnosis/

- https://towardsdatascience.com/microsofts-revolutionary-diagnostic-medical-ai-explained/

- https://derechadiario.com.ar/us/argentina/microsoft-unveils-ai-that-diagnoses-four-times-better-than-a-doctor

- https://developers.google.com/health-ai-developer-foundations/medgemma

- https://deepmind.google/models/gemma/medgemma/

- https://www.infoq.com/news/2025/05/google-medgemma/

- https://github.com/google-research/medical-ai-research-foundations

- https://www.microsoft.com/en-us/research/project/project-innereye-open-source-software-for-medical-imaging-ai/

- https://microsoft.github.io/healthcareai-examples/

- https://github.com/microsoft/healthcareai-examples

- https://github.com/MicrosoftDocs/azure-ai-docs/blob/main/articles/foundry-classic/how-to/healthcare-ai/healthcare-ai-models.md

- https://www.microsoft.com/en-us/microsoft-cloud/blog/healthcare/2024/10/10/unlocking-next-generation-ai-capabilities-with-healthcare-ai-models/

- https://drjessesantiano.com/revolutionary-chatgpt-vs-traditional-medicine-the-surprising-verdict/

- https://psnet.ahrq.gov/node/867132/psn-pdf

- https://techweez.com/2024/11/25/llm-outperforms-physicians-study-finds/

- https://www.advisory.com/daily-briefing/2024/12/03/ai-diagnosis-ec

- https://pmc.ncbi.nlm.nih.gov/articles/PMC12767910/

- https://bestpractice.ai/ai-use-cases/case-studies/healthcare/google-s-verily-prioritizes-patients-by-diagnosing-retinopathy-more-accurately-than-ophthalmologists-using-deep-neural-networks

- https://www.bestpractice.ai/ai-case-study-best-practice/google’s_verily_prioritizes_patients_by_diagnosing_retinopathy_more_accurately_than_ophthalmologists_using_deep_neural_networks

- https://jamanetwork.com/journals/jamainternalmedicine/article-abstract/1108559

- https://dr7.ai/blog/model/medgemma-a-deep-dive-into-googles-open-source-ai-for-healthcare/

- https://www.reddit.com/r/agi/comments/1lo7mhy/microsoft_says_its_new_ai_system_diagnosed/

- https://www.news-medical.net/news/20241106/AI-outperforms-doctors-in-diagnostics-but-falls-short-as-a-clinical-assistant.aspx

- https://documents1.worldbank.org/curated/en/546161470834083341/pdf/WPS7790.pdf

- https://github.com/openmedlab

- https://github.com/topics/diagnostic-model

- https://www.youtube.com/watch?v=7kdDLp-SOsU

- https://github.com/ExpertOpsAI/MedicalModelLibrary

- https://github.com/Karanmehra7107/Medical_Diagnosis